1 - https://arxiv.org/abs/1902.03928

The Degree of Fine-Tuning in our Universe -- and Others

Astrofísica > Cosmologia e Astrofísica Não Galáctica

[Enviado em 11 de fevereiro de 2019]

O Grau de Ajuste Fino em nosso Universo -- e Outros

Fred C. Adams

(resumido) Tanto as constantes fundamentais que descrevem as leis da física quanto os parâmetros cosmológicos que determinam as propriedades cósmicas devem estar dentro de uma faixa de valores para que o universo desenvolva estruturas astrofísicas e, por fim, suporte a vida. Este artigo analisa as restrições atuais sobre essas grandezas. O modelo padrão da física de partículas contém constantes de acoplamento e massas de partículas, e as faixas permitidas desses parâmetros são discutidas primeiro. Em seguida, consideramos os parâmetros cosmológicos, incluindo a densidade total de energia, a densidade de energia do vácuo, a razão bárion-fóton, a contribuição da matéria escura e a amplitude das flutuações de densidade primordial. Essas grandezas são restringidas pelos requisitos de que o universo viva por um longo tempo, emerja da época da BBN com uma composição química aceitável e possa produzir galáxias com sucesso. Em escalas menores, estrelas e planetas devem ser capazes de se formar e funcionar. As estrelas devem ter vidas úteis suficientemente longas e temperaturas superficiais elevadas. Os planetas devem ser massivos o suficiente para manter uma atmosfera, pequenos o suficiente para permanecerem não degenerados e conter partículas suficientes para sustentar uma biosfera complexa. Esses requisitos impõem restrições à constante gravitacional, à constante de estrutura fina e aos parâmetros compostos que especificam as taxas de reação nuclear. Consideramos casos específicos de possível ajuste fino em estrelas, incluindo a reação alfa tripla que produz carbono, bem como os efeitos do deutério instável e dos diprótons estáveis. Para todas essas questões, existem universos viáveis em uma faixa de espaço de parâmetros, que é delineada aqui. Finalmente, para universos com parâmetros significativamente diferentes, novos tipos de processos astrofísicos podem gerar energia e sustentar a habitabilidade.

Comentários: 212 páginas, 36 figuras, aceito para publicação em Physics Reports

Assuntos: Cosmologia e Astrofísica Não Galáctica (astro-ph.CO) ; Física de Altas Energias - Fenomenologia (hep-ph); Física de Altas Energias - Teoria (hep-th)

Citar como: arXiv:1902.03928 [astro-ph.CO]

(ou arXiv:1902.03928v1 [astro-ph.CO] para esta versão)

https://doi.org/10.48550/arXiv.1902.03928

Concentre-se em aprender mais

DOI relacionado :

https://doi.org/10.1016/j.physrep.2019.02.001

Concentre-se em aprender mais

https://www.sciencedirect.com/science/article/abs/pii/S0370157319300511

O grau de ajuste fino em nosso universo — e outros

Os links do autor abrem o painel de sobreposiçãoFred C. Adams

Mostrar mais

Adicionar ao Mendeley

Compartilhar

Citar

https://doi.org/10.1016/j.physrep.2019.02.001

Obtenha direitos e conteúdo

Resumo

Tanto as constantes fundamentais que descrevem as leis da física quanto os parâmetros cosmológicos que determinam as propriedades do nosso universo devem estar dentro de uma faixa de valores para que o cosmos desenvolva estruturas astrofísicas e, em última análise, sustente a vida. Este artigo analisa as restrições atuais sobre essas grandezas. A discussão começa com uma avaliação dos parâmetros que podem variar. O modelo padrão da física de partículas contém constantes de acoplamento e massas de partículas, e as faixas permitidas desses parâmetros são discutidas primeiro. Em seguida, consideramos os parâmetros cosmológicos, incluindo a densidade energética total do universo.

, a contribuição da energia do vácuo

, a razão bárion-fóton

, a contribuição da matéria escura

, e a amplitude das flutuações da densidade primordial

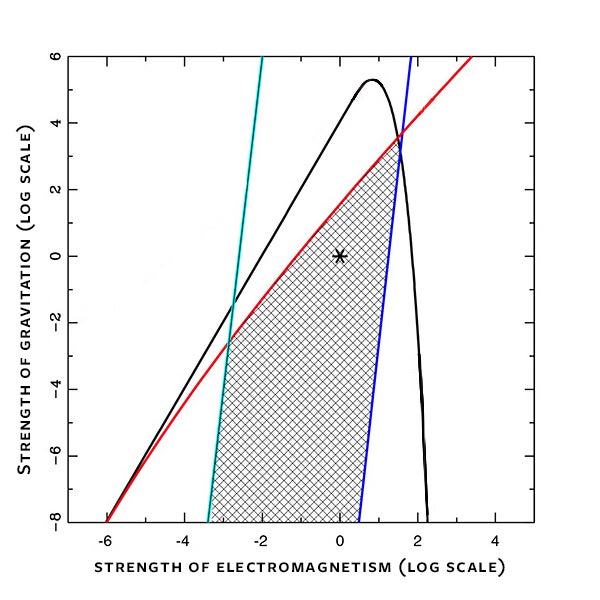

Essas quantidades são limitadas pelos requisitos de que o universo viva por um tempo suficientemente longo, emerja da época da Nucleossíntese do Big Bang com uma composição química aceitável e possa produzir com sucesso estruturas em grande escala, como galáxias. Em escalas menores, estrelas e planetas devem ser capazes de se formar e funcionar. As estrelas devem ter vida suficientemente longa, temperaturas superficiais suficientemente altas e massas menores do que suas galáxias hospedeiras. Os planetas devem ser massivos o suficiente para manter uma atmosfera, mas pequenos o suficiente para permanecerem não degenerados, e conter partículas suficientes para sustentar uma biosfera de complexidade suficiente. Esses requisitos impõem restrições à constante gravitacional da estrutura.

, a constante de estrutura fina

, e parâmetros compostos

que especificam as taxas de reação nuclear. Em seguida, consideramos casos específicos de possível ajuste fino na nucleossíntese estelar , incluindo a reação alfa tripla que produz carbono, o caso do deutério instável e a possibilidade de diprótons estáveis. Para todas as questões descritas acima, universos viáveis existem em uma faixa de espaço de parâmetros, que é delineada aqui. Finalmente, para universos com parâmetros significativamente diferentes, novos tipos de processos astrofísicos podem gerar energia e, assim, sustentar a habitabilidade.

Introdução

As leis da física em nosso universo sustentam o desenvolvimento e as operações da biologia – e, portanto, dos observadores – que, por sua vez, requerem a existência de uma gama de estruturas astrofísicas. O cosmos sintetiza núcleos leves durante sua história inicial e, posteriormente, produz uma grande variedade de estrelas, que forjam as entradas restantes da tabela periódica. Em escalas maiores, as galáxias se condensam a partir do universo em expansão e fornecem poços profundos de potencial gravitacional que coletam e organizam os ingredientes necessários. Em escalas menores, os planetas se formam ao lado de suas estrelas hospedeiras e fornecem ambientes adequados para a gênese e a manutenção da vida. Em nosso universo, as leis da física têm a forma adequada para sustentar todos esses blocos de construção necessários para o surgimento de observadores. No entanto, um grande e crescente corpo de pesquisas tem argumentado que mudanças relativamente pequenas nas leis da física poderiam tornar o universo incapaz de suportar vida. Em outras palavras, o universo poderia ser ajustado para o desenvolvimento da complexidade. O objetivo geral desta contribuição é revisar os argumentos atuais sobre o possível ajuste fino do universo e fazer uma avaliação quantitativa de sua gravidade.

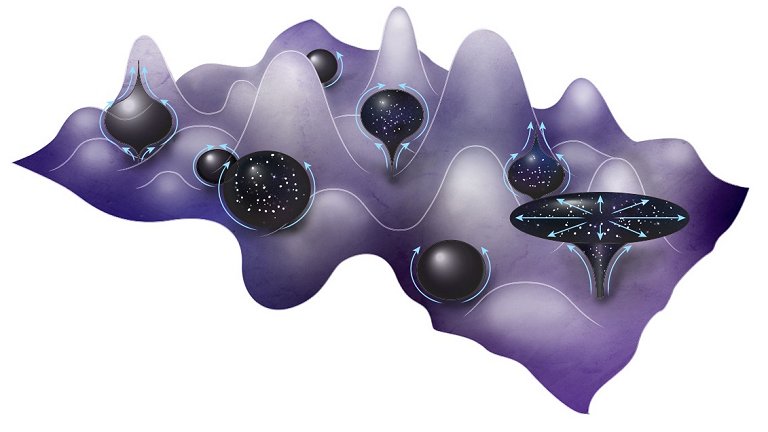

As teorias cosmológicas atuais argumentam que nosso universo pode ser apenas um componente de uma vasta coleção de universos que compõem uma região muito maior do espaço-tempo, frequentemente chamada de “multiverso” ou “megaverso” [1], [2], [3], [4], [5], [6], [7], [8], [9]. Esse conjunto é representado esquematicamente na Fig. 1. Desenvolvimentos paralelos na teoria das cordas e suas generalizações indicam que a estrutura de vácuo do universo poderia ser amostrada a partir de um enorme número de estados possíveis [10], [11], [12], [13], [14], [15]. A função de energia potencial para esse espaço de configuração é representada esquematicamente na Fig. 2, onde cada mínimo corresponde a um universo diferente de baixa energia. Se cada universo individual dentro do multiverso (representado por uma bolha específica na Fig. 1) amostrar a distribuição subjacente de possíveis estados de vácuo (escolhendo um mínimo local específico representado na Fig. 2), as leis da física poderiam variar de região para região dentro do conjunto. Nesse cenário, nosso universo representa um pequeno subdomínio de todo o espaço-tempo com uma implementação específica das versões possíveis das leis da física. Outros domínios poderiam ter partículas elementares com propriedades e/ou parâmetros cosmológicos diferentes. Surge então uma questão fundamental: quais versões das leis da física são necessárias para o desenvolvimento de estruturas astrofísicas, que por sua vez são necessárias para o desenvolvimento da vida?

Os argumentos do ajuste fino têm uma longa história [22], [23], [24], [25]. Embora muitos tratamentos anteriores tenham concluído que o universo é ajustado fino para o desenvolvimento da vida [14], [26], [27], [28], [29], [30], [31], [32], [33], [34], [35], [36], [37], [38], [39], [40], deve-se enfatizar que diferentes autores fazem essa afirmação com graus de convicção amplamente variados (ver também [2], [12], [41], [42], [43], [44], [45], [46]). Também observamos que este tópico foi abordado através das lentes da filosofia (ver [47], [48], [49], [50], [51] e referências nela contidas), embora esta discussão atual se concentre em resultados da física e da astronomia. Em qualquer caso, o conceito de ajuste fino não é definido com precisão. Aqui começamos a discussão fazendo a distinção entre dois tipos de problemas de ajuste:

O significado usual de "ajuste fino" é que pequenas mudanças no valor de um parâmetro podem levar a mudanças significativas no sistema como um todo. Por exemplo, se a força nuclear forte fosse um pouco mais fraca, o núcleo de deutério não estaria mais ligado. Se a força forte fosse um pouco mais forte, os diprótons estariam ligados. Em ambos os exemplos, mudanças relativamente pequenas (aqui, variações de vários pontos percentuais na força forte) levam a inventários nucleares diferentes. Um segundo tipo de ajuste surge quando um parâmetro de interesse tem um valor muito diferente do esperado (geralmente em bases teóricas). A constante cosmológica fornece um exemplo desse problema: o valor observado da constante cosmológica é menor do que algumas expectativas de seu valor por ordens de grandeza. Este segundo tipo de ajuste é, portanto, hierárquico.

No primeiro exemplo, a força nuclear forte pode aparentemente variar apenas por cento sem tornar o deutério instável ou os diprótons estáveis. A estrutura nuclear representa, portanto, uma possível instância de Ajuste Fino Sensível .

No segundo exemplo, o valor da constante cosmológica poderia ser um milhão de vezes menor ou maior (se a amplitude de flutuação também pode variar) e nada catastrófico aconteceria, mas os valores ainda seriam muito menores do que a escala de Planck (por ordens de magnitude ou mais). A constante cosmológica é, portanto, um exemplo de Ajuste Fino Hierárquico .

Além disso, quando surge uma hierarquia inesperada devido a alguma quantidade ser muito menor do que sua escala natural, uma maneira de obter tal ordenação é que dois números grandes quase, mas não completamente, se cancelem. Esse quase cancelamento de grandes quantidades pode ser extremamente sensível aos seus valores exatos e, portanto, pode exigir algum tipo de ajuste. Esse estado de coisas surge, por exemplo, no problema da constante cosmológica [52], [53] (ver Seção 4). Esse conceito geral é conhecido como Naturalidade . Embora existam muitas definições na literatura, a ideia básica é que uma quantidade na física de partículas é considerada não natural se as correções quânticas forem maiores do que o valor observado (para discussões recentes sobre esse assunto, ver [54], [55] e referências nele contidas; para um ponto de vista mais crítico, ver [56]). Em tal situação, as correções quânticas devem (principalmente) se cancelar para permitir que o pequeno valor observado surja. Esse cancelamento não é automático, de modo que requer alguma medida de ajuste fino. Uma maneira de codificar esse conceito, devido a 't Hooft, é declarar um Princípio de Naturalidade: Uma quantidade física deve ser pequena se e somente se a teoria subjacente se torna mais simétrica no limite onde essa quantidade se aproxima de zero [57].

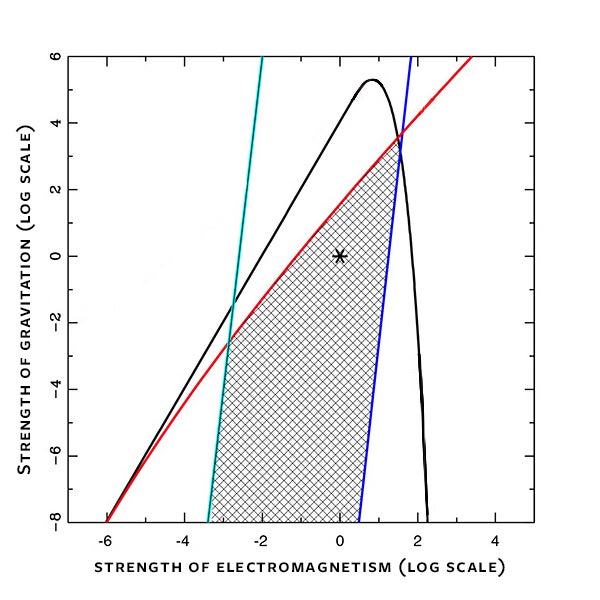

Os constituintes físicos do nosso universo apresentam uma hierarquia de escalas que lhe permite funcionar [30], [45], [58]. Antes de considerar os detalhes do ajuste fino, é útil avaliar o escopo do nosso universo em particular. A Figura 3 ilustra a gama de escalas de comprimento e massa que permitem o funcionamento do nosso universo. As massas e os comprimentos são dados em unidades de massa do próton e de tamanho do próton, respectivamente. O símbolo triangular na origem marca assim a localização do próton. Na outra extremidade do diagrama, a massa e o tamanho do universo observável são marcados pelo triângulo em Objetos que são menores que seus horizontes de eventos () caem abaixo da linha vermelha e se encontram no regime do buraco negro. Objetos que são menores que seus comprimentos de onda Compton () caem abaixo da linha azul e se encontram no regime quântico. Essas duas regiões se encontram na localização de um buraco negro de massa de Planck, marcado pelo triângulo inferior em

. Contornos de densidade constante são mostrados pelas linhas tracejadas na figura. Vários corpos macroscópicos situam-se perto da linha de densidade atômica (curva tracejada do meio), que se estende do átomo de hidrogênio à esquerda até o limite do buraco negro à direita. No meio, o segmento de linha verde mostra o regime de formas de vida conhecidas, variando de bactérias a baleias. Planetas são representados pelos símbolos quadrados e estrelas são representadas pelos círculos. O intervalo de buracos negros conhecidos é mostrado pelo segmento de linha preta grossa. Observe que este segmento é muito menor do que o intervalo total possível de buracos negros, que poderia abranger toda a linha vermelha. Finalmente, a região amostrada por estruturas galácticas é mostrada como a região sombreada na parte superior direita do diagrama.

A Fig. 3 ilustra tanto os desafios quanto as limitações impostas pelas escalas do universo. A amplitude total da massa abrange aproximadamente 80 décadas. A amplitude na escala radial, embora ampla, é mais restrita. A curva tracejada inferior mostra o contorno da densidade nuclear. Em grandes escalas de massa, onde a gravidade pode comprimir o material até atingir densidades mais altas, os objetos se tornam buracos negros. Para massas menores, as forças nucleares dominam, de modo que nosso universo geralmente não produz entidades com tamanhos abaixo da linha de densidade nuclear. A curva tracejada superior corresponde à densidade do universo como um todo. Objetos acima dessa curva teriam densidades menores que a do espaço de fundo e estariam sujeitos à destruição por maré. Como resultado, nosso universo geralmente não produz entidades que se situem acima dessa linha. A amplitude de tamanhos possíveis para uma dada massa, portanto, abrange "apenas" cerca de 15 décadas (com uma amplitude menor em massas elevadas devido ao limite do buraco negro). O universo, com sua estrutura multifacetada, suporta um espaço de parâmetros com extensão de cerca de 80 × 15 décadas. Essa ampla gama de escalas de comprimento e massa é possibilitada pela ampla hierarquia entre a força da gravidade e a força eletromagnética. Como enfatizado anteriormente [30], [45], se a gravidade fosse mais forte, essa gama de escalas seria correspondentemente menor: a linha vermelha se moveria para cima na Figura 3 e o espaço disponível para estruturas astrofísicas diminuiria consequentemente.

Outra característica do universo ilustrada pela Figura 3 é que as regiões ocupadas por tipos específicos de objetos terrestres e astrofísicos são relativamente pequenas. O diagrama mostra as localizações no espaço de parâmetros povoadas por formas de vida, planetas, estrelas, buracos negros e galáxias. Além disso, as regiões povoadas por átomos estão densamente agrupadas perto do ponto mostrado para o átomo de hidrogênio. Da mesma forma, os núcleos estão agrupados perto da localização do próton. Todas essas regiões são pequenas em comparação com o espaço de parâmetros total disponível e estão amplamente separadas umas das outras.

A questão central em análise é se os parâmetros da física em nosso universo estão ajustados com precisão para o desenvolvimento da vida. Essa questão, que pode ser formulada de forma simples, é repleta de complicações. Esta seção descreve os componentes básicos do problema do ajuste fino.

O primeiro passo é especificar quais parâmetros da física e da astrofísica podem variar de universo para universo. É bem conhecido que o Modelo Padrão da Física de Partículas possui pelo menos 26 parâmetros, mas a teoria deve ser estendida para levar em conta aspectos físicos adicionais, incluindo gravidade, oscilações de neutrinos, matéria escura e energia escura (Seção 2). A especificação de tais extensões requer parâmetros adicionais. Por outro lado, nem todos os parâmetros são necessariamente vitais para o funcionamento do universo de baixa energia (que não depende das massas exatas dos quarks pesados). Uma esperança – ainda não concretizada – é que uma teoria mais fundamental teria menos parâmetros e que o grande número de parâmetros do Modelo Padrão poderia ser derivado ou calculado a partir do conjunto menor. Como resultado, o número de parâmetros poderia ser maior ou menor do que os 26 conhecidos. Além dos parâmetros da física de partículas, o Modelo Cosmológico Padrão possui seu próprio conjunto de grandezas necessárias para especificar as propriedades do universo (Seção 3).

Esses parâmetros incluem a razão bárion-fóton., a proporção análoga para a matéria escura, a amplitude

das flutuações da densidade primordial, a densidade de energia do espaço de fundo, e assim por diante.

Em princípio, algumas ou todas essas grandezas poderiam ser calculadas a partir de uma teoria fundamental, mas esse programa não pode ser executado no momento. Mesmo que os parâmetros cosmológicos sejam calculáveis, seus valores poderiam depender da história de expansão do universo específico em questão, de modo que esses valores dependem das condições iniciais (presumivelmente estabelecidas na época de Planck).

Uma vez identificados os parâmetros ajustáveis da física e da cosmologia, uma descrição completa do problema deve considerar suas distribuições de probabilidade.

No caso de um único parâmetro, precisamos conhecer a distribuição de probabilidade subjacente de um universo para obter um determinado valor desse parâmetro. Por exemplo, se a distribuição de probabilidade subjacente for uma função delta, que seria centrada no valor medido em nosso universo, então todos os universos devem ser os mesmos nesse aspecto. No caso mais geral de interesse para argumentos de ajuste fino, as distribuições de probabilidade são consideradas suficientemente amplas para que grandes desvios do nosso universo sejam possíveis. Em particular, a faixa de valores possíveis dos parâmetros (os mínimos e máximos das distribuições) deve ser especificada. Uma avaliação completa do ajuste fino requer o conhecimento dessas distribuições de probabilidade fundamentais, uma para cada parâmetro de interesse (embora não sejam necessariamente independentes). Infelizmente, essas distribuições de probabilidade não estão disponíveis no momento.

As distribuições de probabilidade descritas acima são a priori, ou seja, distribuições teoricamente previstas que se aplicam a um ponto aleatório no espaço-tempo no final da época inflacionária (ou, mais genericamente, qualquer época do universo ultra-inicial que estabeleça suas condições iniciais). Conforme enfatizado pela Ref. [59], também é preciso considerar os efeitos de seleção para testar as previsões teóricas por meio de experimentos. Por exemplo, se um parâmetro afeta a formação de planetas, a distribuição de probabilidade para esse parâmetro será diferente quando avaliada em um ponto aleatório no espaço-tempo ou em um planeta aleatório.

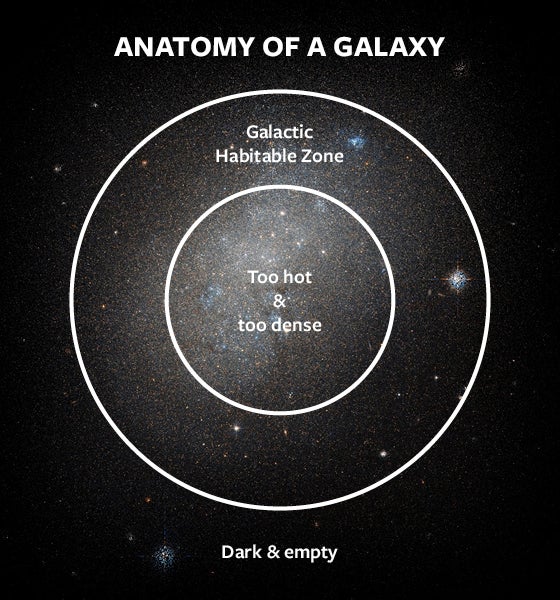

O próximo passo crucial é determinar qual a gama de parâmetros que permite o desenvolvimento de observadores. A questão do que constitui um observador representa mais uma complicação. Para fins de precisão, esta revisão considera um universo bem-sucedido (equivalentemente viável ou habitável) se puder suportar toda a gama de estruturas astrofísicas necessárias para o surgimento da vida ou de algum tipo de complexidade. Assumimos então implicitamente que observadores surgirão se as estruturas necessárias estiverem presentes, e não nos preocuparemos se os observadores resultantes são ratos, golfinhos ou androides. A lista de estruturas necessárias inclui núcleos complexos, planetas, estrelas, galáxias e o próprio universo. Além de sua existência, essas estruturas devem ter as propriedades corretas para suportar observadores. Núcleos estáveis devem povoar uma fração adequada da tabela periódica. As estrelas devem ser suficientemente quentes e viver por um longo período. As galáxias devem ter poços de potencial gravitacional profundos o suficiente para reter elementos pesados produzidos pelas estrelas e não excessivamente densos para que os planetas possam permanecer em órbita. O próprio universo deve permitir que as galáxias se formem e vivam por tempo suficiente para que a complexidade surja. E assim por diante. A maior parte desta revisão descreve as restrições aos parâmetros da física e da astrofísica impostas por esses requisitos.

Para resumir esta discussão: para fazer uma avaliação completa do grau de ajuste fino do universo, é preciso abordar os seguintes componentes do problema:

[

] Especificação dos parâmetros relevantes da física e astrofísica que podem variar de universo para universo.

[

] Determinação dos intervalos permitidos de parâmetros que permitem o desenvolvimento da complexidade e, portanto, dos observadores.

[

] Identificação das distribuições de probabilidade subjacentes das quais os parâmetros fundamentais são extraídos, incluindo todo o intervalo possível que os parâmetros podem assumir.

[

] Consideração de efeitos de seleção que permitem a interpretação de propriedades observadas no contexto das distribuições de probabilidade a priori .

[

] Síntese dos ingredientes anteriores para determinar a probabilidade geral dos universos se tornarem habitáveis.

Este tratamento concentra-se principalmente nas duas primeiras considerações. Tanto para o Modelo Padrão da Física de Partículas quanto para o atual Modelo de Consenso da Cosmologia, revisamos o conjunto completo de parâmetros e identificamos aqueles que têm maior influência na determinação da habitabilidade potencial do universo. A maior parte do manuscrito, então, revisa as restrições impostas às faixas permitidas dos parâmetros relevantes, exigindo que o universo possa produzir e manter estruturas complexas. Infelizmente, as distribuições de probabilidade subjacentes não são conhecidas nem para os parâmetros fundamentais da física nem para os parâmetros cosmológicos. Como resultado, essas distribuições e como elas influenciam os efeitos de seleção são considerados apenas brevemente. Da mesma forma, os efeitos de seleção dependem das distribuições de probabilidade para os parâmetros fundamentais e não podem ser adequadamente abordados neste momento.

A consideração de possíveis universos alternativos, aqui com diferentes encarnações das leis da física, é, por definição, um empreendimento contrafactual. Esta revisão considera as faixas de parâmetros físicos que permitem que tal universo seja viável. Como universos alternativos não são observáveis, esse esforço necessariamente se situa próximo dos limites da ciência [1], [5]. No entanto, esta discussão é útil em várias frentes: primeiro, pode-se levar a sério a existência do multiverso, de modo que outros universos sejam considerados como realmente existentes, e a questão de sua possível habitabilidade seja relevante [9]. Além disso, se a teoria do multiverso se tornar suficientemente desenvolvida, então, em princípio, poder-se-ia prever a probabilidade de um universo ter uma realização particular das leis da física e, portanto, estimar a probabilidade de um universo se tornar habitável. Em segundo lugar, argumentos antrópicos [28], [30] estão sendo usados atualmente como explicação para o motivo pelo qual o universo tem sua versão observada das leis da física. Para compreender ambas as questões, o primeiro passo é determinar as faixas de parâmetros que permitem que um universo desenvolva estrutura e complexidade. Por fim, e talvez o mais importante, estudar o grau de ajuste necessário para o universo operar nos proporciona uma maior compreensão de como ele funciona.

Nesta revisão, o termo multiverso refere-se ao conjunto de outros universos possíveis representados esquematicamente na Figura 1 — outras regiões do espaço-tempo que são distantes e amplamente desconectadas do nosso próprio universo. Para completar, notamos que a Interpretação de Muitos Mundos da mecânica quântica [60], [61] descreve a realidade física como bifurcando-se em múltiplas cópias de si mesma, e essa coleção de possibilidades às vezes também é chamada de multiverso [3]. Aqui, consideramos o multiverso apenas no primeiro sentido, cosmológico. A filosofia da mecânica quântica e, portanto, o segundo tipo de multiverso, está além do escopo deste tratamento.

Esta revisão está organizada da seguinte forma: consideramos inicialmente o Modelo Padrão da Física de Partículas na Seção 2. Após discutir toda a gama de parâmetros, focamos no subconjunto de grandezas que têm maior influência na determinação das propriedades de estruturas complexas e, em seguida, discutimos as restrições sobre esses parâmetros, resultantes principalmente de considerações da física de partículas. Restrições adicionais resultantes de requisitos astrofísicos são discutidas nas seções subsequentes. O Modelo Padrão da Cosmologia é apresentado na Seção 3. Toda a gama de parâmetros cosmológicos é revisada, juntamente com uma avaliação das grandezas mais importantes para a produção de estrutura e algumas restrições básicas sobre o inventário cósmico. O caso da constante cosmológica (energia escura) é de particular interesse e é considerado separadamente na Seção 4. A época da Nucleossíntese do Big Bang (BBN) também é considerada separadamente na Seção 5, que avalia como as abundâncias dos elementos leves mudam com a variação dos valores dos parâmetros cosmológicos de entrada. A formação de galáxias e a estrutura galáctica são consideradas na Seção 6, que fornece restrições sobre parâmetros fundamentais e cosmológicos devido às propriedades galácticas necessárias. A Seção 7 considera as restrições devido à necessidade de estrelas em funcionamento, que são necessárias para ter configurações de queima nuclear estáveis, vidas úteis suficientemente longas e fotosferas quentes. Esta seção também revisita as questões clássicas da ressonância alfa tripla para a produção de carbono, os efeitos do deutério instável e os efeitos dos diprótons estáveis. As propriedades necessárias dos planetas são consideradas na Seção 8, onde as restrições de parâmetros são semelhantes – mas menos limitantes – às de considerações estelares. Cenários mais exóticos são introduzidos na Seção 9, incluindo fontes alternativas de geração de energia, como a aniquilação da matéria escura e a radiação de buracos negros. O artigo conclui na Seção 10 com um resumo das restrições de ajuste fino e uma discussão de suas implicações. Uma série de Apêndices fornece uma discussão mais aprofundada e apresenta algumas questões auxiliares, incluindo um resumo das escalas de massa astrofísica em termos das constantes fundamentais Apêndice A, o número de dimensões espaço-temporais Apêndice B, bioquímica molecular Apêndice C, limites globais nas constantes de estrutura Apêndice D, uma breve discussão das distribuições de probabilidade subjacentes para os parâmetros ajustáveis Apêndice E e o intervalo de núcleos possíveis Apêndice F.

Uma nota sobre a notação: A literatura da física de partículas geralmente usa unidades naturais onde

,

, e

A maior parte da nossa discussão sobre tópicos de física de partículas segue essa convenção. Por outro lado, a maior parte da literatura astrofísica usa unidades CGS, portanto, a discussão sobre estrelas e planetas inclui os fatores relevantes de

e

.

Acesso através da sua organização

Verifique o acesso ao texto completo fazendo login na sua organização.

Trechos de seção

Parâmetros da física de partículas

Uma avaliação completa dos parâmetros da física de partículas – juntamente com uma análise do seu possível grau de ajuste fino – é dificultada pelo atual estado de desenvolvimento da área. Por um lado, o Modelo Padrão da Física de Partículas fornece uma descrição notavelmente bem-sucedida da maioria dos resultados experimentais até o momento. Além de seus inúmeros sucessos, a teoria é elegante e bem fundamentada. Por outro lado, esta teoria é incompleta. Já sabemos que extensões ao modelo mínimo

Parâmetros cosmológicos e o inventário cósmico

Esta seção descreve os parâmetros cosmológicos necessários para descrever um universo como membro do multiverso. Começamos com uma revisão dos parâmetros cosmológicos necessários para especificar o estado atual do nosso próprio universo. No entanto, alguns desses parâmetros têm relativamente pouco efeito na formação da estrutura e não são necessários para que um universo arbitrário seja habitável. Assim, definimos o subconjunto de parâmetros relevantes para considerações de ajuste fino em todo o universo.

A constante cosmológica e/ou energia escura

Embora nosso universo possa ser especificado por relativamente poucos parâmetros cosmológicos (ver Seção 3), um dos ingredientes necessários é uma densidade energética substancial do vácuo — frequentemente chamada de energia escura. Essa quantidade atua como uma constante cosmológica e é atualmente o componente dominante do inventário cósmico (ver Tabela 1). A energia escura está impulsionando a aceleração observada atualmente no universo e terá enormes consequências no futuro [204], [205], [206]. Além disso, a

Nucleossíntese do Big Bang

Para que um universo se torne habitável, ele deve produzir núcleos complexos com sucesso. Em nosso universo, a nucleossíntese ocorre em múltiplos cenários, incluindo o universo primordial, núcleos estelares, explosões de supernovas e espalação no meio interestelar. Nos primeiros minutos de sua história, nosso universo processa cerca de um quarto de seu material bariônico em hélio-4 durante uma época conhecida como Nucleossíntese do Big Bang (BBN). Embora as estrelas também produzam hélio, esse processamento inicial

Formação de galáxias e estrutura em larga escala

As galáxias são componentes vitais de um universo habitável. Elas coletam e organizam o gás interestelar necessário para a formação de estrelas, que fornecem a energia e os núcleos pesados necessários para o desenvolvimento biológico. De igual importância, as galáxias devem ter massa suficiente para reter os elementos pesados produzidos pela nucleossíntese estelar. Para cumprir essas funções, as galáxias devem primeiro ser capazes de se formar.

A formação de galáxias envolve uma série de processos físicos (ver [248] para uma revisão recente e

Estrelas e evolução estelar

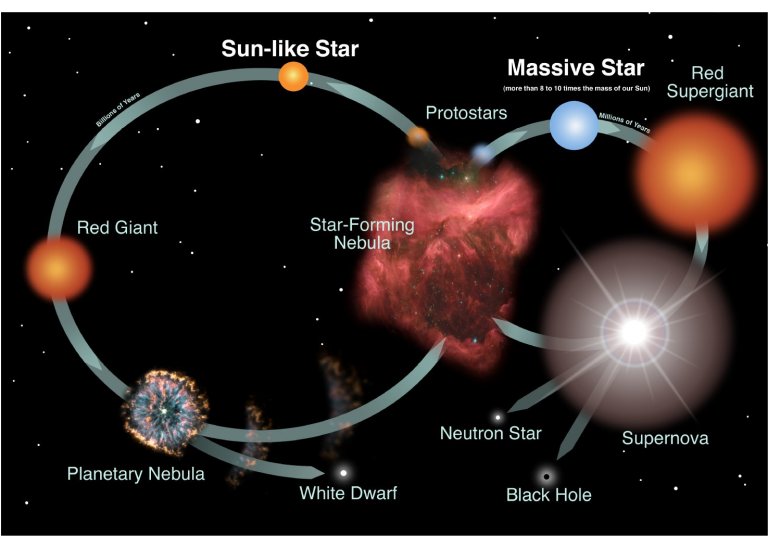

As estrelas desempenham dois papéis importantes em relação à habitabilidade do nosso universo, e presumivelmente outros. Primeiro, elas fornecem a maior parte da energia [150] disponível para sustentar biosferas em quaisquer planetas convenientemente situados. Segundo, elas forjam a maioria dos núcleos pesados necessários para o desenvolvimento de estruturas complexas [296], [297], que vão desde os próprios planetas até entidades biológicas.

Planetas

Os planetas representam os menores objetos astrofísicos necessários para o desenvolvimento da vida (como a conhecemos). Para que um determinado universo se torne habitável, as leis da física devem permitir a produção de planetas com uma série de propriedades básicas, conforme descrito nesta seção. Esses corpos devem ter massa suficientemente pequena para que não se degenerem. Este requisito também é necessário (mas não suficiente) para que o planeta tenha uma superfície sólida [374]. Por outro lado, a

Cenários astrofísicos exóticos

Nossa bolha local de espaço paramétrico é adequada para habitabilidade, e a discussão até agora se concentrou em delinear os limites dessa região. Dada a ampla gama de parâmetros da física de partículas e cosmológicos que poderiam ser realizados em todo o multiverso, torna-se possível que outros universos utilizem caminhos e fontes de energia não convencionais. Como resultado, bolhas adicionais de habitabilidade poderiam existir com propriedades cósmicas marcadamente diferentes das nossas. Esta seção explora

Conclusão

Uma intrincada rede de restrições deve ser satisfeita para que um dado universo seja viável. Esta seção fornece um guia através do labirinto, organizando os resultados desta revisão de diversas maneiras: a Seção 10.1 apresenta um resumo direto dos resultados mais importantes. A Seção 10.2 identifica as tendências gerais que emergem deste conjunto de restrições. A relação com os argumentos antrópicos é abordada na Seção 10.3, e as variações de parâmetros que potencialmente permitem...

Ajuste fino do Universo para a vida pode ser uma ilusão

Com informações da Fundação John Templeton - 09/02/2022

Ajuste fino do Universo para a vida pode ser uma ilusão

Com informações da Fundação John Templeton - 09/02/2022

Multiverso

Nas últimas décadas, algumas das mentes mais perspicazes da física sentiu-se atraída pelo que se convencionou chamar de "problema do ajuste fino" - ou sintonia fina.

Ao sondar as leis físicas do Universo e determinar com precisão os valores das constantes físicas - como as massas das partículas elementares e as magnitudes das forças - os físicos descobriram que variações surpreendentemente pequenas nesses valores teriam criado um Universo sem vida.

Isso levou a um enigma: Por que as condições físicas do Universo são aparentemente tão bem adaptadas à existência humana?

Alguns físicos explicaram essas condições como acidentais invocando a teoria do multiverso, que propõe que há um número infinito de universos paralelos, cada um com diferentes parâmetros físicos. Dentro dessa estrutura em multiverso, não seria tão surpreendente que os humanos tenham evoluído em uma das realidades paralelas em que as condições são habitáveis para nós.

Ajuste fino desnecessário

Com o apoio do Instituto de Questões Fundamentais (FQXi) e da Fundação John Templeton, a física Miriam Frankel elaborou um extenso relatório no qual ela explora a complexa história da pesquisa sobre o ajuste fino, incluindo possíveis explicações para ela - como aquelas derivadas da teoria das cordas e do multiverso - e avaliando propostas para testar experimentalmente essas explicações direta e indiretamente.

Ocorre que o criterioso levantamento, abarcando as pesquisas mais recentes, encontrou poucas razões para que sequer seja necessário aventar o ajuste fino.

"Acontece que a sintonia necessária para que alguns desses parâmetros físicos deem origem à vida é menos precisa do que a sintonia necessária para captar uma estação em seu rádio, segundo novos cálculos," disse Frankel. "Se for verdade, o aparente ajuste fino pode ser uma ilusão."

Flexibilidade do Universo

Em seu relatório, Frankel observa que a vida pode assumir uma forma muito diferente da que temos ingenuamente imaginado e que, se vários parâmetros físicos forem considerados como variando simultaneamente, essas variações podem aliviar quaisquer problemas aparentes de ajuste fino.

Isso sugere que o Universo pode não ser assim tão finamente ajustado; ele pode ser capaz de produzir vida sob uma gama muito mais ampla de circunstâncias do que se pensava inicialmente.

Mas as equações da estrutura estelar podem ter mais soluções do que a maioria das pessoas imagina.

"As estrelas podem continuar a funcionar com variações substanciais nas constantes fundamentais," disse o professor Fred Adams, astrofísico da Universidade de Michigan, cujo trabalho é analisado no relatório. "Além disso, se um processo astrofísico em particular se tornar inoperável, então (frequentemente) outro processo pode tomar seu lugar para ajudar a fornecer energia para o Universo".

"Quando os parâmetros necessários para a vida parecem aparecer em regiões suspeitamente estreitas, procuramos explicações para isso como coincidência ou conspiração cósmica. Descobrir que essas regiões podem ser mais amplas, ou que existem outras regiões que permitem a vida, enfraquece a necessidade de tais explicações. Pode ser que, no final, não haja nenhuma conspiração," disse David Sloan, físico da Universidade de Lancaster, cuja pesquisa também é apresentada no relatório.

3 - https://www.islamreligion.com/pt/articles/10518/viewall/ajuste-fino-do-universo-parte-1-de-8

Ajuste fino do universo (parte 1 de 8): Leis da física

https://www.islamreligion.com/pt/articles/10522/ajuste-fino-do-universo-parte-2-de-8

Ajuste fino do universo (parte 2 de 8): Constantes & condições iniciais

https://www.islamreligion.com/pt/articles/10524/ajuste-fino-do-universo-parte-3-de-8

Ajuste fino do universo (parte 3 de 8): Quatro exemplos de ajuste fino

m/pt/articles/10523/ajuste-fino-do-universo-parte-4-de-8

Ajuste fino do universo (parte 4 de 8): Exemplos extremos de ajuste fino

https://www.islamreligion.com/pt/articles/10528/ajuste-fino-do-universo-parte-5-de-8

Ajuste fino do universo (parte 5 de 8): Objeções ao ajuste fino

https://www.islamreligion.com/pt/articles/10529/ajuste-fino-do-universo-parte-6-de-8

Ajuste fino do universo (parte 6 de 8): Como podemos explicar o ajuste fino?

https://www.islamreligion.com/pt/articles/10539/ajuste-fino-do-universo-parte-7-de-8

Ajuste fino do universo (parte 7 de 8): Universos múltiplos

Ajuste fino do universo (parte 1 de 8): Leis da física

Descrição: O ajuste fino é um argumento da física e cosmologia para a criação divina do universo. Será mostrado que descobertas da física e cosmologia nos últimos cinquenta anos dão grande apoio à existência de Deus e à criação divina do universo. Esse artigo descreverá as leis elegantes e finamente ajustadas da natureza.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 19 Dec 2016

- Última modificação em 30 Oct 2022

- Impresso: 54

- 'Visualizado: 21,090

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

O que é ajuste fino?

_por-BR._001.jpg)

O universo tem um ajuste fino para a existência de vida inteligente com uma complexidade e delicadeza que literalmente desafiam a compreensão humana. A sensibilidade da "habitabilidade" do universo a mudanças pequenas é chamada de "ajuste fino".

Isso foi reconhecido há aproximadamente 60 anos por Fred Hoyle, que não era uma pessoa religiosa na época em que fez a descoberta. Cientistas como Paul Davies, Martin Rees, Max Tegmark, Bernard Carr, Frank Tipler, John Barrow e Stephen Hawking, para mencionar alguns, acreditam no ajuste fino. Esses são nomes proeminentes em cosmologia e são ouvidos na mídia toda vez que há alguma manchete.

Tipos de ajuste fino

1. Ajuste fino das leis da natureza.

2. Ajuste fino das constantes da física.

3. Ajuste fino das condições iniciais do universo.

Exploraremos cada categoria abaixo:

1. Ajuste fino das leis da natureza

Existem duas maneiras de analisar esse aspecto do ajuste fino:

1. As leis certas que são necessárias, de maneira precisa, para que vida altamente complexa possa existir. Se uma dessas estiver faltando, essa vida não seria possível. Dizer que as leis são finamente ajustadas significa que o universo deve ter o conjunto certo de leis, para que vida altamente complexa possa existir. Talvez esse tipo de ajuste fino seja o mais fácil de compreender dentre os três.

Exemplo 1: A lei da gravidade afirma que todas as massas se atraem. Como seria o universo se a gravidade não existisse? Não haveria estrelas ou planetas. A matéria seria distribuída igualmente em todo o universo sem lugar para vida se formar ou fontes de energia como o sol, que fornece alimento para plantas por meio da fotossíntese que, por sua vez, se tornam alimento para animais.

Exemplo 2: Um tipo de força pode desempenhar papeis múltiplos nesse sistema muito bem projetado. Por exemplo, a força eletromagnética se refere a combinação de forças elétricas e magnéticas. James Clerk Maxwell unificou as duas forças nos anos 1800.

Se não houvesse força eletromagnética não haveria átomos, porque não haveria força para segurar os elétrons com carga negativa com os prótons com carga positiva, que permite as ligações químicas. Não haveria elementos constitutivos da vida, já que não haveria ligação química e, portanto, não haveria vida.

A força eletromagnética desempenha outro papel na luz, que é um tipo de radiação eletromagnética. Permite que a energia se transfira do sol para o nosso planeta. Sem essa energia, não existiríamos.

2. Harmonia entre natureza e matemática: Somente no século 20 passamos a entender que o que observamos na natureza pode ser descrito por algumas leis físicas, cada uma descrita por equações matemáticas simples. É incrível fato de essas formas matemáticas serem tão simples e poucas em número a ponto de poderem ser todas escritas em uma folha de papel.

Tabela1. As leis fundamentais da natureza

·Mecânica (Equações de Hamilton)

·Eletrodinâmica (Equações de Maxwell)

![]()

![]()

·Mecânica estatística (Equações de Boltzmann)

![]()

![]()

·Mecânica quântica (Equações de Schrödinger)

![]()

![]()

·Relatividade geral (Equação de Einstein)

![]()

Para a vida existir, precisamos de um universo ordenado e inteligível. Além disso, é necessário ordem em muitos níveis diferentes.

Por exemplo, para ter planetas que circulam suas estrelas, precisamos da mecânica newtoniana.

Para haver múltiplos elementos estáveis da tabela periódica para prover uma variedade suficiente de "elementos constitutivos" atômicos para vida, precisamos da estrutura atômica dada pelas leis da mecânica quântica.

Precisamos da ordenação nas reações químicas que é a consequência da equação de Boltzmann para a segunda lei da termodinâmica.

E para uma fonte de energia com o sol transferir sua energia que dá vida para um habitat como a Terra, são necessárias as leis de radiação eletromagnética que Maxwell descreveu.[1]

O físico e ganhador do prêmio Nobel Eugene Wigner em seu trabalho amplamente citado The Unreasonable Effectiveness of Mathematics in the Physical Sciences destaca que os cientistas geralmente dão como certo a eficácia notável - e até milagrosa - da matemática em descrever o mundo real. Ele diz:

"A utilidade enorme da matemática é algo que se aproxima do misterioso... Não há explicação racional para isso... O milagre da adequação da linguagem da matemática para a formulação das leis da física é uma dádiva maravilhosa que não compreendemos ou merecemos."[2]

Notas de rodapé:

http://www.leaderu.com/real/ri9403/evidence.html

[2] Wigner, Eugene. 1960. The Unreasonable Effectiveness of Mathematics in the Physical Sciences. Communications on Pure and Applied Mathematics, vol. 13: 1-14)

Ajuste fino do universo (parte 2 de 8): Constantes & condições iniciais

Descrição: Uma explicação simples do que significa o ajuste fino das constantes da natureza e das condições iniciais do universo.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 19 Dec 2016

- Última modificação em 25 Jun 2019

- Impresso: 56

- 'Visualizado: 16,848

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

2. Ajuste fino das constantes

_por-BR._001.jpg)

As leis da natureza não determinam o valor dessas constantes. Pode haver um universo governado pelas mesmas leis, mas com valores diferentes para essas constantes. Portanto, os valores reais dessas constantes não são determinados pelas leis da natureza. Dependendo dos valores daquelas constantes, um universo governado pelas mesmas leis da natureza será muito diferente.

Há pelo menos 20 constantes e fatores independentes que são finamente ajustados a um nível elevado de precisão, para a vida ser possível no universo. Estima-se que aproximadamente todos os anos outro número é adicionado à lista.[1]

G: Exemplo de uma constante finamente ajustada

Um exemplo de uma constante é a constante gravitacional - designada por G - que determina a força da gravidade via Lei da gravidade, de Newton.

_por-BR._002.gif)

F é a força entre duas massas ![]() e

e ![]() que estão afastadas a uma distância r. O valor real de G é 6,67 x 10-11 N

que estão afastadas a uma distância r. O valor real de G é 6,67 x 10-11 N ![]() . Aumente ou diminua G e a força da gravidade aumentará ou diminuirá de maneira correspondente.

. Aumente ou diminua G e a força da gravidade aumentará ou diminuirá de maneira correspondente.

Se a força da gravidade fosse aumentada em uma parte em 1034, até mesmo organismos de uma célula seriam esmagados e somente planetas com menos de 9 m de diâmetro sustentariam vida com o nosso tamanho de cérebro. Tais planetas, entretanto, não poderiam sustentar um ecossistema para suportar vida com o nosso nível de inteligência. De fato, mesmo um ecossistema básico dificilmente seria possível em tal lugar.

De fato, se G fosse aumentado 64 vezes, a força gravitacional da superfície de qualquer planeta que pudesse reter uma atmosfera seria no mínimo 4 vezes maior. Um aumento de 400 vezes em G resultaria em um planeta com uma força de superfície no mínimo 10 vezes maior. Esse planeta seria muito menos ideal do que a terra, para os humanos. Por outro lado, uma pequena diminuição em G afetaria negativamente o ciclo hidrológico do planeta, fazendo também qualquer planeta habitável menos ideal.[2]

3. Ajuste fino das condições iniciais do universo

Além das constantes existem certas quantidades arbitrárias que são colocadas como condições iniciais sobre as quais as leis da natureza operam. Como essas quantidades são arbitrárias, também não são determinadas pelas leis da natureza.

Primeiro darei um exemplo simples para explicar o que isso significa. Quando jogo uma bola, a jogo em certo ângulo e com certa velocidade. O ângulo e a velocidade são as "condições iniciais". Após jogá-la, a bola segue certo curso e onde ela cai dependerá das "condições iniciais". O curso adotado pela bola é calculado usando a lei da gravidade, que é uma das leis da física.

Agora, pegue um exemplo da entropia (desordem termodinâmica) no universo primitivo. É uma "condição inicial" no modelo do Big Bang, semelhante à velocidade e ângulo para a bola, no exemplo acima. Assim como o exemplo da bola, depois do Big Bang, as leis da física assumem o controle e determinam como o universo se desenvolverá a partir dali. Se a entropia inicial (uma condição inicial) do universo tivesse sido diferente, as leis preveriam um universo muito diferente.

Aqui é a parte incrível. Os cientistas descobriram que essas constantes e condições iniciais devem estar em uma faixa muito estreita de valores, para o universo existir. Isso é o que significa "o universo ter sido finamente ajustado para a vida."

Notas de rodapé:

Ajuste fino do universo (parte 3 de 8): Quatro exemplos de ajuste fino

Descrição: São discutidos quatro exemplos de ajuste fino: ajuste fino que permite vida no planeta Terra, ressonância de carbono, a força nuclear forte e a razão entre a força nuclear forte e a força eletromagnética.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 26 Dec 2016

- Última modificação em 25 Jun 2019

- Impresso: 52

- 'Visualizado: 16,171

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

1. Ajuste fino para permitir um planeta habitável

_por-BR._001.jpg)

·Deve ter um sistema solar único, para suportar órbitas planetárias estáveis.

·O sol deve ter a massa correta. Se fosse maior, seu brilho mudaria muito rapidamente e não haveria muita radiação de energia elevada. Se fosse menor, a faixa de distâncias planetárias capaz de suportar vida seria muito estreita; a distância certa seria tão próxima da estrela que forças de maré perturbariam o período rotacional do planeta. A radiação ultravioleta também seria inadequada para a fotossíntese.

·A distância da terra ao sol deve ser exata. Muito próximo e a água evaporaria, muito longe e a terra seria muito fria para vida. Uma mudança de apenas 2% e toda a vida cessaria.

·A Terra deve ter massa suficiente para reter uma atmosfera.

·A gravidade de superfície e a temperatura também são fundamentais dentro de uma pequena porcentagem para que a Terra tenha uma atmosfera que sustente a vida - retendo a mistura de gases correta necessária para a vida.

·A Terra deve girar na velocidade certa: muito lenta e as diferenças de temperatura entre dia e noite seriam muito extremas, muito rápida e a velocidade do vento seria desastrosa.

·A gravidade da terra, a inclinação axial, período de rotação, campo magnético, espessura da crosta, razão oxigênio/nitrogênio, dióxido de carbono, vapor de água e níveis de ozônio têm que ser exatos.

O astrofísico Hugh Ross[2] lista muitos desses parâmetros que têm que estar finamente ajustados para a vida ser possível e faz um cálculo aproximado, mas conservador de que a chance de tal planeta existir no universo é de aproximadamente 1 em 1030.

2. Ajuste fino da "ressonância" de carbono

A vida requer muito carbono, que faz moléculas complexas. O carbono é formado pela combinação de três núcleos de hélio ou pela combinação de núcleos de hélio e berílio. O carbono é como o cubo de roda em um brinquedo de encaixe: pode-se ligar os elementos a moléculas mais complicadas (vida com base em carbono), mas as ligações não são tão fortes que não possam ser rompidas novamente, para fazer outra coisa.

O eminente matemático e astrônomo Fred Hoyle constatou que para isso acontecer os níveis de energia do estado fundamental nuclear têm que estar finamente ajustados entre si. Esse fenômeno se chama "ressonância".

O nível de ressonância de carbono é determinado por duas constantes: a "força forte" e a "força eletromagnética". Se desorganizar essas forças ligeiramente, perde carbono ou oxigênio. Se a variação fosse maior que 1% em uma direção ou outra, o universo não poderia sustentar vida.

Hoyle confessou mais tarde que nada tinha abalado tanto seu ateísmo quanto essa descoberta.[3]

3. Ajuste fino da força nuclear forte

A "força forte" é a força que liga prótons e nêutrons em núcleo. Se a constante da força forte fosse 2% mais forte, não haveria hidrogênio estável, não haveria estrelas de vida longa e compostos contendo hidrogênio. Isso porque o único próton no hidrogênio se ligaria a tudo e não sobraria nenhum hidrogênio!

Se a constante da força forte fosse 5% mais fraca, não haveria estrelas estáveis e poucos elementos, além de hidrogênio. Isso porque não seria possível construir os núcleos de elementos mais pesados, que contêm mais de 1 próton.

Assim, ou se ajusta a força forte para cima ou para baixo, perdendo estrelas que servem como fonte de energia ou perdendo química complexa necessária para a vida.

4. Razão entre força nuclear forte e força eletromagnética

Se a razão entre a força nuclear forte e a força eletromagnética tivesse sido diferente em 1 parte em 1016, nenhuma estrela teria se formado. Aumente-a em somente 1 parte em 1040 e só podem existir estrelas pequenas, diminua-a na mesma quantidade e só haverá estrelas grandes. Deve-se ter estrelas grandes e pequenas no universo. As grandes produzem elementos em suas fornalhas termonucleares e apenas as pequenas queimam por tempo suficiente para sustentar um planeta com vida.[4]

Para colocar 1040 em perspectiva, ter uma precisão de uma parte em 1030 (um número muito menor) é como atirar e atingir uma ameba no limite do universo observável!

Arno Penzias, um físico americano ganhador do Nobel que co-descobriu a radiação cósmica de fundo e ajudou a estabelecer o Big Bang, resume o que vê:

"A astronomia nos leva a um evento único, um universo que foi criado do nada, com um equilíbrio muito delicado necessário para prover exatamente as condições certas exigidas para permitir vida e que tem um plano (que se pode chamar de "sobrenatural") inerente."[5]

Notas de rodapé:

Ajuste fino do universo (parte 4 de 8): Exemplos extremos de ajuste fino

Descrição: Três exemplos extremos de ajuste fino com ilustrações de o quanto os números são grandes e o quanto o nosso universo está finamente ajustado.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 26 Dec 2016

- Última modificação em 25 Jun 2019

- Impresso: 53

- 'Visualizado: 17,551

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

Primeiro, os físicos identificam quatro forças fundamentais da natureza. Em termos de força crescente, são gravidade (G0), força fraca (1031 G0), força eletromagnética (1037 G0) e a força nuclear forte (1040G0).

Segundo, uma vez que exemplos extremos de ajuste fino lidam com números extraordinariamente grandes, precisamos ter uma ideia de o quanto são grandes. Isso nos dará alguma perspectiva de o quanto o ajuste fino é delicado:

·número médio de células em um corpo humano é 1013 (ou seja, 10 trilhões)

·idade do universo é aproximadamente 1017s

·estima-se que o número de partículas subatômicas no universo conhecido seja 1080

Mantendo esses números em mente, considerem os três exemplos de ajuste fino a seguir:

1. Força nuclear fraca

Uma delas, a "força nuclear fraca" que trabalha dentro do núcleo de um átomo é tão sensível (finamente ajustado) que até mesmo uma alteração de uma parte em 10100 impediria a vida no universo![1]

2. Constante cosmológica

A constante cosmológica é um termo na teoria da gravidade de Einstein que tem a ver com aceleração da expansão do universo. É descrito como propriedade auto dilatante do espaço (ou mais precisamente espaço-tempo).[2] A menos que esteja dentro de uma faixa extremamente estreita em torno de zero, o universo entrará em colapso ou se expandirá tão rapidamente pelas galáxias e estrelas para chegar a se formar. A constante é finamente ajustada a um nível inimaginavelmente preciso. Se fosse mudada no mínimo que fosse, como uma parte em 10120, o universo não teria vida![3]

3. Número de penrose: O exemplo mais extremo de ajuste fino

Não é isso. De acordo com o modelo padrão de cosmologia, o modelo do universo aceito hoje, voltando 14 bilhões de anos pode-se pensar no universo como condensado a menos que o tamanho de uma bola de golfe. O estado inicial do espaço-tempo e, portanto, gravidade, do universo primitivo tinha entropia muito baixa[4]. Essa entropia baixa é necessária para um universo habitável no qual são formadas estruturas de entropia alta, como estrelas. A "massa-energia" do universo inicial tinha que ser precisa para alcançar galáxias, planetas e para existirmos. O exemplo mais extremo de ajuste fino tem a ver com a distribuição de massa-energia naquele momento.

Qual a precisão?

Roger Penrose da universidade de Oxford e um dos físicos teóricos e cosmólogos mais importantes da Grã-Bretanha, calculou que as chances de um estado de baixa entropia existir por acaso é de um em 1010^123 - o número de penrose. Escreveu em seu livro "The Road to Reality": "Criação do universo, uma descrição fantástica! O distintivo do Criador tem que encontrar uma minúscula caixa, apenas 1 parte em 1010^123 do volume espaço fásico inteiro, para criar um universo com um Big Bang tão especial como o que encontramos." [5]

Em seu outro livro, "The Emperor’s New Mind", observou: "Para produzir um universo semelhante ao que vivemos, o Criador teria que ter como meta um volume absurdamente mínimo do espaço fásico de universos possíveis - em torno de 1/1010^123 do volume inteiro, para a situação sob consideração." [6]

Vamos ter uma ideia de que tipo de número estamos falando?

Não existem partículas suficientes no universo (que saibamos) para escrever todos os zeros! É como um dez elevado a um expoente de:

Esse número é tão grande que se cada zero fosse 10 tipos de pontos, preencheriam uma grande parte do nosso universo![7]

É por isso que explicaremos com quatro ilustrações.

Primeiro, equilibrar um bilhão de lápis simultaneamente posicionados na vertical sobre suas pontas afiadas em uma superfície lisa de vidro sem apoio vertical não chega nem perto de descrever uma precisão de uma parte em 1060.[8]

Segundo, é muito mais precisão do que seria necessário para lançar um dardo e atingir uma moeda de um centavo do outro lado do universo![9]

Uma terceira ilustração sugerida pelo astrofísico Hugh Ross[10] pode ajudar. Cubra a América com moedas em uma coluna alcançando a lua (380.000 km ou 236.000 milhas de distância) e então faça o mesmo por um bilhão de outros continentes do mesmo tamanho. Pinte uma moeda de vermelho e coloque-a em algum lugar em um bilhão de pilhas. Coloque uma venda em um amigo e peça para pegar a moeda. As chances de pegá-la são 1 em 1037.

Todos esses números são extremamente pequenos quando comparados ao ajuste fino preciso do número de penrose, o exemplo mais extremo de ajuste fino que conhecemos.

Em resumo, o ajuste fino de muitas constantes de física deve recair em uma faixa extremamente estreita de valores, para a vida existir. Se tivessem valores ligeiramente diferentes, nenhum sistema material complexo poderia existir. Isso é um fato amplamente reconhecido.

Notas de rodapé:

Ajuste fino do universo (parte 5 de 8): Objeções ao ajuste fino

Descrição: 1. Três objeções ao ajuste fino são respondidas. 2. Por que o ajuste fino precisa de uma explicação? 3. Uma ilustração de ajuste fino com uma máquina geradora do universo. 4. O deslumbramento dos ateus de o quanto o universo é finamente ajustado.

- Por Imam Mufti (© 2017 IslamReligion.com)

- Publicado em 02 Jan 2017

- Última modificação em 25 Jun 2019

- Impresso: 54

- 'Visualizado: 18,112

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

Três objeções ao ajuste fino[1]

_por-BR._001.jpg)

Por "vida" os cientistas querem dizer a propriedade de organismos se alimentarem, converterem em energia, crescerem, se adaptarem ao seu meio-ambiente e reproduzirem. Para a vida existir, constantes e condições iniciais têm que estar ajustadas finamente ou, de outro modo, até os precursores da vida - planetas, galáxias, química - não existiriam! Novamente, a pergunta é puramente especulativa.

2.Outra objeção pode ser: "E universos governados por leis diferentes da natureza, que permitem formas de vida radicalmente diferentes daquelas em nosso universo? Talvez constantes e condições iniciais naqueles universos não sejam finamente ajustadas?

A resposta a essa pergunta é irrelevante para explicar o ajuste fino do nosso universo. Não compreendemos nosso universo bem o suficiente para nos aprofundarmos em pura especulação sobre outros universos que não sabemos se existe.

3.Alguém pode objetar: "Você não pode mudar um parâmetro, mantendo todos os outros constantes. Mudar outro parâmetro pode compensar pelos efeitos inibidores de vida de uma troca de parâmetro em particular."

A resposta é que não se pode compensar pelas mudanças feitas a um parâmetro.[2] Por exemplo, reduzir a força fraca pode ser compensado pela redução da diferença de massa entre próton e nêutron no universo primitivo. Entretanto, mudar um parâmetro tem muitos efeitos. Reduzir a força fraca também afeta a explosão da supernova e a decadência radioativa.

Por que o ajuste fino precisa de uma explicação?

Alguém pode dizer: "o universo simplesmente é, por que é necessária uma explicação para o ajuste fino?" [3]

Será distintamente estranho, como Keith Ward comenta, "pensar que há uma razão para tudo, exceto para o item mais importante de todos - ou seja, a existência de tudo, o universo em si." [4]

Imagine uma máquina criadora do universo, como um cofre gigante com dois tipos de mostradores. Existem mostradores que fixam as configurações para as leis da física como gravidade, eletromagnetismo e as forças nucleares. Também tem mostradores para a constante de Planck, um para a proporção da massa do nêutron para a massa do próton, um para a força da atração eletromagnética e assim por diante. Inicialmente todos os mostradores foram configurados e fixados em números particulares. Esses números são constantes da natureza e produzem o universo no qual vivemos.

Digamos que você pode mudar os mostradores dessa máquina geradora de universo. Também há uma tela que mostra o que aconteceria se você alterasse os mostradores, ainda que minimamente.

Você pode alterar os mostradores e apertar o botão de visualização para ver o que pode acontecer. Você enfraquece a força do eletromagnetismo e a força da gravidade só um pouco. Então toca o botão de visualização e vê os resultados na tela. De repente, estrelas, galáxias e planetas começam a cair! Então você aumenta o mostrador da força eletromagnética e, de repente, os planetas não estão no tamanho certo. São grandes demais para vida. As estrelas também queimam rapidamente.

O que você inferirá sobre a origem dessas configurações finamente ajustadas do mostrador?[5]

A maioria das pessoas acha difícil acreditar que um universo finamente ajustado seja apenas um fato que não tem e nem exige uma explicação. O universo apenas passar a existir soa tão científico quanto responder à pergunta de por que as maçãs caem no chão dizendo que elas simplesmente caem.[6]

Alguém aceitará que uma fotografia de um rosto seja simplesmente o resultado de um derramamento de tinta? Ninguém jamais aceitaria um acidente como explicação. Se não aceitarão derramamento de tinta como explicação para uma fotografia, como alguém aceitaria o universo ser finamente ajustado sem explicação?

Além disso, o ajuste fino é um fato científico bem estabelecido, admitido por físicos que não são amigos do teísmo. Mesmo eles não conseguem esconder o deslumbramento do quanto o universo é finamente ajustado:

Stephen Hawking: "Seria muito difícil explicar por que o universo deve ter começado dessa forma, exceto como o ato de um Deus que pretendeu criar seres como nós".[7]

"O fato notável é que os valores desses números (ou seja, as constantes da física) parecem ter sido ajustados muito finamente para possibilitar o desenvolvimento de vida." [8]

Steven Weinberg: "Pode haver uma constante cosmológica nas equações de campo cujos valores cancelam os efeitos da densidade de massa do vácuo produzida pelas flutuações quânticas. Mas para evitar conflito com a observação astronômica, esse cancelamento teria que ser preciso em pelo menos 120 casas decimais. Por que deve haver uma constante cosmológica ajustada de maneira tão precisa no mundo?" [9]

Dr. Dennis Sciama: ex-diretor dos observatórios da universidade de Cambridge, disse: "Se as leis da natureza fossem alteradas minimamente... é muito provável que vida inteligente não teria conseguido se desenvolver." [10]

Martin Rees: "A possibilidade de vida como a conhecemos depende de valores de algumas constantes físicas básicas e, em alguns aspectos, é notavelmente sensível aos valores numéricos dessas constantes. A natureza não exibe coincidências notáveis." [11]

Paul Davies: "Para mim existe evidência poderosa de que há algo acontecendo por trás de tudo... Parece que alguém ajustou finamente os números da natureza para fazer o universo... A impressão do projeto é arrebatadora." [12]

Notas de rodapé:

O trabalho de pesquisa explora ajuste bidimensional: o que acontece quando se altera o tamanho dos quarks para cima e para baixo, simultaneamente? Constataram que são produzidos 9 efeitos distintos pela simples alteração nas massas dos quarks para cima e para baixo. Quarks para cima e para baixo são partículas fundamentais da natureza que compõem os prótons e nêutrons.

Russell, Bertrand e Copleston, Frederick. 1964. Debate on the Existence of God em The Existence of God, ed. John Hick. Nova Iorque: Macmillan. 174-75.

Tryton repetiu Russell: "Nosso universo simplesmente é uma daquelas coisas que acontecem de tempos em tempos." Tryton, E. 1971. Is the Universe a Vacuum Fluctuation? Nature 246:396.

Carl Sagan começou seu best-seller com as palavras: "O cosmos é tudo que existe, tudo que jamais existiu e tudo que jamais existirá." (Sagan, Carl. 1985. Cosmos. Nova Iorque: Ballatine Books. 1.)

Ajuste fino do universo (parte 6 de 8): Como podemos explicar o ajuste fino?

Descrição: Ajuste fino e projeto são duas ideias separadas. Discutiremos todas as explicações possíveis para o ajuste fino e ver que a criação divina é a única escolha razoável reconhecida até por alguns ateus.

- Por Imam Mufti (© 2017 IslamReligion.com)

- Publicado em 02 Jan 2017

- Última modificação em 25 Jun 2019

- Impresso: 52

- 'Visualizado: 16,889

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

Para muitas pessoas a evidência do ajuste fino sugere imediatamente a criação divina, como explicação. Até alguns ateus, às vezes, não conseguem resistir em admitir essa interpretação de bom senso. O físico teórico e escritor popular de ciência Paul Davies escreveu: "A impressão do projeto é arrebatadora." [1] Depois de descobrir um dos primeiros casos de ajuste fino, o astrofísico Fred Hoyle declarou: "Uma interpretação de bom senso dos fatos sugere que um super-intelecto tenha mediado com a física e também com a química e a biologia e que não existem forças cegas das quais valham a pena se falar na natureza. Os números que se calculam a partir dos fatos me parecem tão incríveis de modo a colocar essa conclusão quase que além de questionamento." [2]

Entretanto, para exaurir todas as explicações, primeiro, separaremos duas palavras: ajuste fino e projeto. Segundo, aplicaremos explicações causais mutuamente exaustivas para eliminar as menos prováveis e selecionar a melhor.

Ajuste fino é um termo neutro que não diz nada sobre como explicá-lo. Significa apenas que uma faixa de valores de constantes e condições iniciais do universo no momento do Big Bang era extremamente estreita e as leis da física estão configuradas de maneira precisa Se os valores de ao menos uma dessas constantes ou condições iniciais fossem alterados pela espessura de um fio de cabelo, não haveria vida no universo hoje. O equilíbrio delicado exigido para a vida teria sido perturbado.

A seguir, exploraremos todas as outras explicações possíveis de ajuste fino:

O universo é autoexplicativo

Alguns dizem que o universo é usa própria explicação, ou seja, é autoexplicativo.[3]

Não se preocupe se não compreender o que isso significa, porque a ideia se contradiz. É logicamente impossível para uma causa provocar um efeito sem existir. John Lennox observa: "Tentativas de argumentar que o universo é autoexplicativo se mostraram autocontraditórias já que a simples aceitação de um começo como um fato bruto é insatisfatória." [4]

Necessidade

"Necessidade" significa que as constantes e quantidades devem ter os valores que têm. Mas por que o universo tem que permitir vida? Por que as constantes e condições iniciais têm que ser o que são?

Não existem boas respostas para essas perguntas e, portanto, a necessidade física é implausível uma vez que não há evidência de que universos que permitem vida sejam necessários.

De fato, universos que proíbem vida são mais prováveis que um que permita vida. Como Paul Davies escreveu: "Parece, então, que o universo físico não tem que ser do jeito que é: podia ser de outra forma." [5]

O universo foi criado pelas leis da física ou autogerado

Se um bolo não pode gerar a si mesmo, como um universo pode gerar a si mesmo? É difícil de acreditar, mas alguns ateus sugerem que o universo passou a existir por uma teoria, leis da física ou matemática.[6]

Primeiro, atribuir inteligência a leis matemáticas e acreditar que podem ser inteligentes não faz sentido.

Segundo, explicações de fenômenos físicos como o nascer do sol no Oriente com leis da física são descritivas e preditivas, mas não criativas. Quem criou essas leis? A lei da gravidade de Newton não cria gravidade ou faz com que algo aconteça. Substitua o universo por um motor a jato. Diremos que alguém o fez para um propósito específico ou ignoraremos o agente que o fez e diremos que o motor a jato surgiu naturalmente a partir das leis da física? Isso seria absurdo. Deus não compete ou entra em conflito com leis da física como explicação. Leis da física podem explicar como o motor a jato funciona, mas não como passou a existir, em primeiro lugar.[7] Lennox colocou isso bem em uma de suas palestras: "bobagem continua bobagem, mesmo se dita por cientistas famosos."

Acaso ou força bruta?

O ajuste fino pode ser resultado de acaso? Pode ser um acidente que todas as constantes e condições iniciais tenham caído na faixa que permite vida? O problema é que as chances de um universo que permite vida existir são tão remotas que essa alternativa não é razoável. Nenhum físico respeitável (incluindo ateus), acredita que o ajuste fino pode ser explicado por puro acaso.

Alguém pode perguntar: "quando algo é tão improvável que se torna impossível?" Williams Dembski, um matemático, tentou responder a essa pergunta em seu livro, The Design Inference. Considera o número de partículas no universo e também considera o número de segundos no universo, que ele coloca em 1025. Então ele multiplica isso por 1045 como o número de eventos ou reações que podem ocorrer por segundo. Com base nisso, chega a uma probabilidade que é uma vez e meia em 10150. Qualquer coisa além daquele limite de probabilidade, diz ele, não é diferente de uma impossibilidade.

Além disso, a objeção é respondida com uma ilustração dada por John Leslie.[8] Digamos que você é arrastado para frente de um pelotão de fuzilamento de 100 atiradores treinados e de pé a pouca distância. Você ouve "Preparar! Apontar! Fogo!" Então ouve o som de armas, mas, surpreendentemente, ainda está vivo! Todos os 100 atiradores erraram? A que conclusão chegaria?

Você diria: "Acho que não devia me surpreender que todos erraram! Afinal, se não tivessem errado, não estaria aqui! Não há mais nada a explicar!"

Nenhuma pessoa em seu juízo perfeito aceitará essa explicação. À luz da enorme improbabilidade de todos os atiradores errarem, uma conclusão razoável será que todos erraram de propósito.

Notas de rodapé:

"Não há necessidade de invocar qualquer coisa sobrenatural nas origens do universo ou da vida. Nunca gostei da ideia de ajuste divino: para mim é muito mais inspirador acreditar que um conjunto de leis matemáticas pode ser tão esperto a ponto de fazer todas essas coisas existirem." Paul Davies relatado por Cookson, Clive. 1995. Scientists Who Glimpsed God. Financial Times, April 29, p.20.

Lennox é um matemático e filósofo de ciência britânico que é professor de matemática na universidade de Oxford.

Ajuste fino do universo (parte 7 de 8): Universos múltiplos

Descrição: É dada uma explicação de como o naturalismo leva a uma hipótese multiverso, seguida por uma crítica de hipótese “de muitos mundos” por cientistas de destaque. Entretanto, a crença em muitos mundos não conflita com a crença em Deus, mesmo que a hipótese se desenvolva em uma teoria futura.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 09 Jan 2017

- Última modificação em 25 Jun 2019

- Impresso: 52

- 'Visualizado: 18,174

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0

_por-BR._001.jpg)

Portanto, devido ao fato de não ter sido encontrada nenhuma explicação natural para o ajuste fino, alguns físicos recorrem a uma explicação naturalística - multiverso (universos múltiplos).

A ideia é que se existir um vasto multiverso, os recursos probabilísticos disponíveis para levar em conta para nosso universo ser finamente ajustado por acaso, aumentam. Portanto, muitos cientistas ateus chegaram a conclusão de que o ajuste fino precisa de explicação, a menos que se suponha muitos mundos.

De acordo com essa ideia, existe um número enorme de universos com condições iniciais, valores de constantes e até leis da física diferentes. Nosso universo é apenas um membro desse "multiverso" em (provavelmente) universos aleatórios infinitos. Se todos esses mundos realmente existem então, por acaso, universos que permitem vida terão observadores neles e eles observarão como seu mundo é finamente ajustado.

Portanto, não há necessidade de dizer que nosso universo foi finamente ajustado para a via, ou seja, que as leis, constantes e condições iniciais foram configuradas de forma precisa para permitir a vida.

Assim, simplesmente por acaso, algum universo terá a "combinação vencedora" para a vida. É exatamente como se produz bilhetes de loteria. Mesmo que seja uma chance em 10 milhões, o bilhete ganhador vai aparecer no final. De acordo com essa ideia, os seres humanos são ganhadores de uma "loteria cósmica". Quando ela aparece, os humanos evoluem, olham para trás e dizem: "tivemos sorte!"

Algumas observações sobre universos múltiplos (hipótese do multiverso)

Primeira consideração: Não há nenhuma evidência que prove a existência desses universos multiversos. Por questão de princípio, não conseguimos nem mesmo observá-los.[1] É por isso que a ideia tem sido fortemente criticada por cientistas de destaque:

John Polkinghorne de Cambridge, um ex-professor de física matemática, chamou a ideia de "pseudociência" e "uma adivinhação metafísica." [2]

Em outro lugar ele disse: "O relato dos muitos universos às vezes é apresentado como se fosse puramente científico, mas de fato é um portfólio suficiente de universos diferentes que só podem ser gerados por processos especulativos que vão muito além do que a ciência séria pode endossar de maneira honesta." [3]

Arno Penzias, um físico americano ganhador do Nobel que codescobriu a radiação cósmica de fundo e ajudou a estabelecer o Big Bang, coloca o argumento dessa forma: "Algumas pessoas estão desconfortáveis com o mundo criado com um propósito. Para apresentar coisas que contradigam o propósito tendem a especular sobre o que não viram." [4]

Martin Rees é um cosmólogo e astrofísico britânico de Cambridge e antigo presidente da Royal Society. Em uma entrevista no ano de 2000 com um jornalista de ciência, admitiu que os cálculos são "altamente arbitrários" e que a teoria em si "se apoia em suposições", continua especulativa e não é passível de investigação direta. "Os outros universos não estão disponíveis para nós, assim como o interior de um buraco negro", disse ele. Acrescentou que não podemos nem saber se os universos são finitos ou infinitos em número.[5]

Richard Swisburne, um filósofo de destaque, comenta: "Postular um trilhão-trilhão de outros universos, ao invés de um Deus para explicar a ordenação de nosso universo, parece o ápice da irracionalidade." [6]

Segunda consideração: viola o princípio da Navalha de Ockham, que afirma que a explicação mais plausível é aquela com o menor número de suposições e condições.[7]

Terceira consideração: Todas as teorias do multiverso de fato têm requisitos de ajuste fino. Consequentemente, o ajuste fino de um "multiverso" precisará de uma explicação. Para ser crível, deve ser sugerido um mecanismo plausível para muitos mundos. De onde veio o "gerador de multiverso"? Um "gerador de multiverso" exigirá um "projeto". Precisaria ser "bem construído" com as leis corretas e ter os ingredientes corretos (condições iniciais) para funcionar e produzir universos que sustentem vida. Por exemplo, examinando o multiverso inflacionário das supercordas, ele requer pelo menos cinco mecanismos ou leis especiais. Quem ou "o que" projetou esse gerador hipotético permanece sem resposta.

Portanto, a hipótese do gerador de universo não anula o argumento do ajuste fino; ao contrário, eleva em um nível a questão do ajuste fino.

Quarta consideração: Uma vez que o multiverso não pode ser observado, como alguém pode saber que os outros mundos são menos ordenados e mais caóticos e infrutíferos que o nosso? Se o único mundo que conhecemos e podemos usar como pista para a estrutura de outros é aquele no qual vivemos, e ele é finamente ajustado, então por analogia os outros mundos devem ter sido ao menos tão bem projetados como esse. Isso exigiria um Criador ainda mais poderoso.[8]

Quinta consideração: Apesar de no momento presente não haver evidência científica de que o multiverso existe, não parece haver necessidade de negar essa possibilidade.[9] Assim como existem muitos planetas mortos em nosso universo, talvez, apenas talvez, também existam muitos universos mortos. O interessante é que existe um teorema importante[10] que afirma que mesmo que se um multiverso que gerou nosso universo existisse, ele deve ter um começo! Consequentemente, será mais bem explicado pelo projeto de um Criador poderoso e não acaso.

Para resumir, a hipótese de multiverso é puramente especulativa. Mesmo que venha a ter mérito científico, ela é totalmente compatível com a crença em Deus.

Universo ou multiverso, o ajuste fino ganha. Cabeças ou rabos, o Criador ganha.

Notas de rodapé:

2. Yaran, Cafer. 2003. Islamic Thought on the Existence of God. Washington: The Council for Research in Values and Philosophy. 74.

Ver também Yaran, Cafer. 2003. Islamic Thought on the Existence of God. Washington: The Council for Research in Values and Philosophy. 73.

Yaran, Cafer. 2003. Islamic Thought on the Existence of God. Washington: The Council for Research in Values and Philosophy. 75-76.

Ajuste fino do universo (parte 8 de 8): Resumo do ajuste fino do universo

Descrição: A criação divina é a explicação mais convincente para o ajuste fino do universo depois de analisar todas as outras explicações possíveis. 2. A ciência é limitada por sua natureza e, assim, não pode fornecer respostas definitivas. 3. Reflexões semelhantes dos cavalgadores de camelos até os pensadores dos dias atuais nos contam que a “evidência” para Deus é igualmente acessível a todos.

- Por Imam Mufti (© 2016 IslamReligion.com)

- Publicado em 09 Jan 2017

- Última modificação em 25 Jun 2019

- Impresso: 52

- 'Visualizado: 16,288

- Classificado por: 0

- Enviado por email: 0

- Comentado em: 0